特斯拉還在FSD的端到端架構中迭代優化時,中國造車新勢力已悄然開啟了智能駕駛的范式革命。在NVIDIA GTC 2025的聚光燈下,理想汽車自動駕駛技術負責人賈鵬展示的MindVLA架構,不僅突破了傳統駕駛的技術框架,更在人工智能與自動駕駛物理智能體的融合探索中樹立了新的行業標桿。

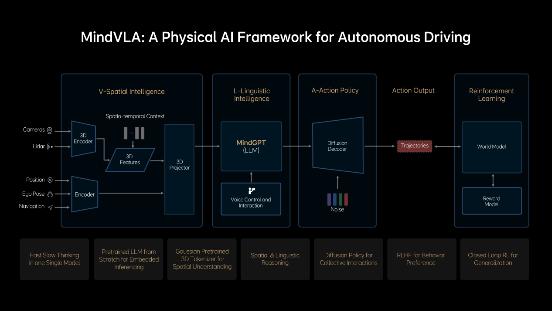

那么,這個重新定義自動駕駛的MindVLA架構究竟是什么?賈鵬解釋道:“MindVLA是一個機器人大模型,它成功整合了空間智能、語言智能和行為智能。一旦跑通物理世界和數字世界結合的范式,它將有望賦能更多行業。同時,MindVLA將把汽車從單純的運輸工具轉變為貼心的專職司機,它能聽得懂、看得見、找得到。我們希望MindVLA能為汽車賦予類似人類的認知和適應能力,將其轉變為能夠思考的智能體。”

MindVLA打破自動駕駛技術框架設計的傳統模式,使用能夠承載豐富語義,且具備出色多粒度、多尺度3D幾何表達能力的3D高斯(3D Gaussian)這一優良的中間表征,充分利用海量數據進行自監督訓練,極大提升了下游任務性能。

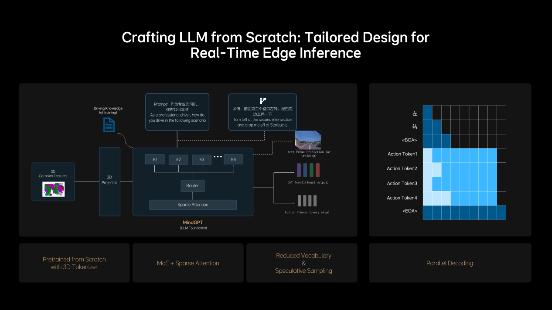

理想從0開始設計和訓練了適合MindVLA的LLM基座模型,采用MoE混合專家架構,引入Sparse Attention(稀疏注意力),實現模型稀疏化,保證模型規模增長的同時,不降低端側的推理效率。基座模型訓練過程中,理想加入大量3D數據,使模型具備3D空間理解和推理能力。為了進一步激發模型的空間智能,理想加入了未來幀的預測生成和稠密深度的預測等訓練任務。

LLM基座模型獲得3D空間智能的同時,還需要進一步提升邏輯推理能力。理想訓練LLM基座模型學習人類的思考過程,讓快慢思考有機結合到同一模型中,并可以實現自主切換快思考和慢思考。為了把NVIDIA Drive AGX的性能發揮到極致,MindVLA采取小詞表結合投機推理,以及創新性地應用并行解碼技術,進一步提升了實時推理的速度。至此,MindVLA實現了模型參數規模與實時推理性能之間的平衡。

MindVLA利用Diffusion將Action Token解碼成優化的軌跡,并通過自車行為生成和他車軌跡預測的聯合建模,提升在復雜交通環境中的博弈能力。同時,MindVLA采用Ordinary Differential Equation(常微分方程)采樣器,實現了2-3步就能完成高質量軌跡的生成。值得一提的是,相較于特斯拉純視覺方案對數據量的重度依賴,MindVLA通過重建+生成的云端世界模型,構建出虛實交融的訓練環境,使得系統能夠實現"從錯誤中學習"的強化閉環。這種技術路徑的差異,本質上是將智能駕駛從"數據驅動"升級為"認知驅動",顯著提升了場景重建與生成的質量和效率。

在用戶感知層面,MindVLA帶來的不僅是技術參數的提升,更是人車交互范式的重構,它就是你“聽得懂”、“看得見”、“找得到”的專職司機。當車輛能夠理解“帶我去找超市”、"開太快了"等語義指令;能通認識星巴克、肯德基等不同的商店招牌并通過照片定位自主尋人;甚至在沒有地圖支持的情況下完成空間推理……它就不再只是一個駕駛工具,而是一個能與用戶溝通、理解用戶意圖的智能體,這種轉變將重新定義智能駕駛的競爭維度。

相關行業人士指出,MindVLA展現出的跨場景適應能力,可能打開智能駕駛的商業化新藍海。其在各個場景的突破,實質上是將L4級技術的應用場景從限定區域向泛化場景延伸,就像iPhone 4重新定義了手機,MindVLA也將重新定義自動駕駛,為行業探索出一條兼顧性能與效率的可行路徑。

寫在最后:

這場由理想汽車引領的技術變革,正在重構智能駕駛的價值坐標系。當車輛開始具備空間推理、語義理解和自主決策能力,我們或將見證一個新時代的開啟:汽車不再是被動的交通工具,而是能理解、會思考、懂適應的智能體。這種轉變不僅關乎技術突破,更預示著人車關系的根本性重構——在MindVLA架構的驅動下,汽車正在成為人類在物理世界中最具智慧的"數字伴侶"。